BAB 5 THE MADELIN

The Madaline (Banyak Adaline) adalah ekstensi multilayer dari bipolar

single-neuron adaline ke jaringan. Karena Madaline adalah ekstensi

multi-layer metodologi penyesuaian lebih berat daripada di Back

Propagation dan memberikan pemahaman yang sulit ke dalam menyesuaikan

bobot dalam jaringan multi-layer, meskipun kurang efisien. Struktur

dasar diberikan pada Gambar. 5.1 yang dalam hal dua lapisan Adalines,

ditambah lapisan masukan yang hanya berfungsi sebagai distributor

masukan jaringan (lihat Gambar. 5.2).

Pelatihan Madaline

Pelatihan Madaline berbeda dari pelatihan Adaline bahwa tidak ada

output parsial yang diinginkan dari bagian dalam lapisan yang dapat

tersedia. Sehingga bagian dalam lapisan disebut lapisan tersembunyi.

Sama seperti dalam sistem saraf pusat manusia (CNS), kita dapat menerima

informasi dalam hasil yang diinginkan dan tidak diinginkan, meskipun

manusia tidak sadar hasil dari neuron individu yang berpartisipasi

dalammenerima informasi, sehingga dalam JST tidak ada informasi dari

dalam lapisan neuron tersedia.

Studi Kasus Madaline :

Character Recognition

- Problem statement

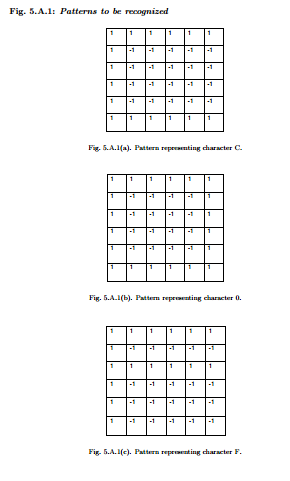

Merancang Madaline (Multiple Adaline) Neural Network untuk mengenali 3

karakter 0, C dan F disediakan dalam format biner dan mewakili

menggunakan 6 × 6 kotak. Neural Network harus dilatih dan diuji dengan

berbagai pola, total tingkat kesalahan dan jumlah konvergensi harus

diamati. pola khusus yang digunakan untuk pelatihan dan pengujian adalah

sebagai pada Gambar. 5.A.1.

Sebuah jaringan Madaline seperti pada Gambar. 5.A.2 dirancang dengan 3

lapisan, masukan (6neuron), tersembunyi (3 neuron), dan output (2

neuron), lapisan. 36 masukan dari grid mengandung karakter 0, C atau F

diberikan sebagai masukan ke jaringan. 15 input set diberikan, 5

masing-masing selama 3 dan 0 itu. Bobot jaringan yang awalnya ditetapkan

di secara acak dalam kisaran {-1, 1}.

Berikut ini adalah langkah-langkah dasar untuk Pelatihan dari Jaringan Neural Back Propagation :

- Gunakan data training set dengan 5 set 0 , C dan F masing-masing.

- Umpan set pelatihan ini (lihat Gambar. 5.A.3) ke jaringan.

- Set bobot jaringan secara acak di kisaran {-1, 1}.

- Gunakan hardlimiter fungsi transfer untuk setiap neuron.

Setiap output lulus sebagai masukan ke lapisan berturut-turut.

- Output akhir dibandingkan dengan output yang diinginkan dan kesalahan kumulatif untuk 15 input dihitung.

- Jika kesalahan persen di atas 15% (untuk neuron yang memiliki output terdekat 0) maka bobot dari lapisan output berubah menggunakan

Berat (s) diperbarui dan kesalahan baru ditentukan.

- Berat diperbarui untuk berbagai neuron sampai tidak ada kesalahan atau kesalahan adalah dibawah ambang batas yang diinginkan.

- Uji kumpulan data diumpankan ke jaringan dengan bobot diperbarui dan output (error) diperoleh dengan demikian menentukan efisiensi jaringan.

4. The Training Sets

5. Hasil

Hasilnya seperti berikut:

• Lapisan Tersembunyi Bobot Matrix:

w hidden =

• Lapisan Tersembunyi Bobot Matrix:

w hidden =

- The Neural Network dilatih dan diuji untuk pengujian dan pelatihan pola yang berbeda. Dalam semua kasus jumlah konvergensi dan error tingkat diamati.

- Konvergensi sangat bergantung pada lapisan tersembunyi dan jumlah neuron di setiap lapisan tersembunyi.

- Jumlah di setiap lapisan tersembunyi harus tidak terlalu kurang atau terlalu tinggi.

- Jaringan Syaraf terlatih sangat akurat dalam mengklasifikasikan data yang di sebagian besar kasus uji. Jumlah kesalahan yang diamati adalah 6% (approx.), Yang sangat ideal untuk masalah klasifikasi seperti Face Detection.

Komentar

Posting Komentar